本地私有化部署DeepSeek模型的教程

DeepSeek 模型是一种强大的语言模型,本地私有化部署可以让用户在自己的环境中安全、高效地使用该模型,避免数据传输到外部带来的安全风险,同时也能根据自身需求进行定制化配置。本教

|

DeepSeek 模型是一种强大的语言模型,本地私有化部署可以让用户在自己的环境中安全、高效地使用该模型,避免数据传输到外部带来的安全风险,同时也能根据自身需求进行定制化配置。本教程将详细介绍如何在本地进行 DeepSeek 模型的私有化部署。 二、环境准备(一)硬件要求

(二)软件要求

(三)创建虚拟环境为了避免不同项目之间的依赖冲突,建议使用虚拟环境。在命令行中执行以下命令创建并激活虚拟环境:

三、安装依赖库在激活的虚拟环境中,安装必要的 Python 依赖库,主要包括 PyTorch、Transformers 等:

四、获取 DeepSeek 模型(一)下载模型文件DeepSeek 模型可以从 Hugging Face 模型库(https://huggingface.co/deepseek-ai)下载。根据自己的需求选择合适的模型版本,如 deepseek-llm-7b 或 deepseek-llm-67b 等。可以使用以下代码在 Python 中下载模型:

或者使用 git lfs 命令直接从 Hugging Face 仓库下载:

(二)模型文件结构下载完成后,模型文件通常包含以下几个主要部分:

五、模型推理测试在本地部署好模型后,可以进行简单的推理测试,验证模型是否正常工作。以下是一个使用 Python 进行推理的示例代码:

六、使用 API 进行部署(一)使用 FastAPI 搭建推理 APIFastAPI 是一个快速(高性能)的 Python Web 框架,非常适合用于构建机器学习模型的 API。以下是一个使用 FastAPI 为 DeepSeek 模型搭建推理 API 的示例代码:

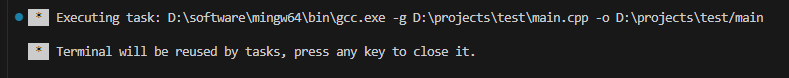

(二)运行 API 服务将上述代码保存为 main.py,然后在命令行中运行以下命令启动 API 服务:

这里 --host 0.0.0.0 表示可以从任何 IP 地址访问该服务,--port 8000 表示服务监听的端口号为 8000。 (三)测试 API可以使用 curl 命令或 Postman 等工具来测试 API。以下是使用 curl 命令的示例:

如果一切正常,你将收到一个包含输入文本和模型生成输出的 JSON 响应。 七、性能优化(一)量化模型量化是一种将模型参数从高精度(如 32 位浮点数)转换为低精度(如 8 位整数)的技术,可以显著减少模型的内存占用和推理时间。可以使用 transformers 库中的量化功能对 DeepSeek 模型进行量化:

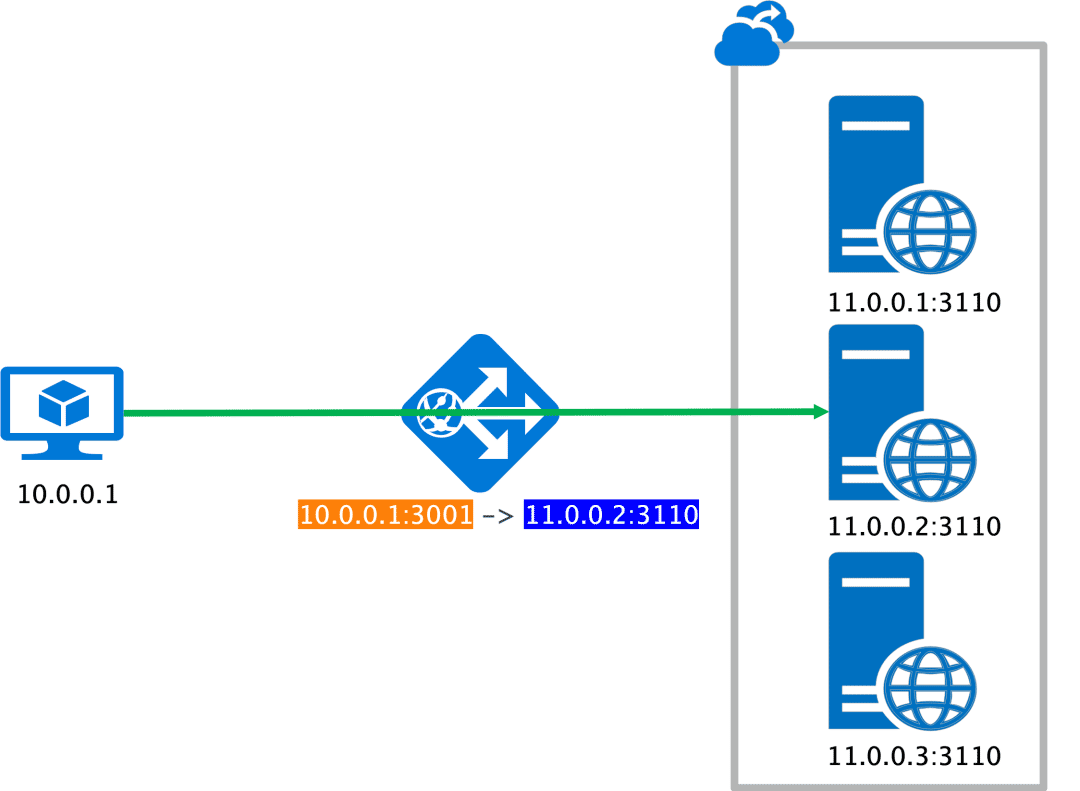

(二)使用分布式推理如果有多个 GPU 或多台机器,可以使用分布式推理来加速模型的推理过程。torch.distributed 模块提供了分布式训练和推理的功能。以下是一个简单的分布式推理示例:

八、安全与管理(一)数据安全在本地私有化部署中,要确保数据的安全性。对于输入和输出的数据,要进行严格的访问控制和加密处理。可以使用 HTTPS 协议来保护 API 的通信安全,避免数据在传输过程中被窃取。 (二)模型更新与维护定期检查 DeepSeek 模型的官方更新,及时下载并更新本地模型,以获取更好的性能和功能。同时,要对模型的运行状态进行监控,及时发现并处理可能出现的问题。 (三)资源管理合理管理服务器的资源,避免因资源过度使用导致系统崩溃。可以使用监控工具(如 Prometheus、Grafana 等)来监控服务器的 CPU、内存、GPU 等资源的使用情况,并根据监控结果进行调整。 九、总结通过以上步骤,你可以在本地完成 DeepSeek 模型的私有化部署,并使用 API 进行推理服务。在部署过程中,要注意环境准备、模型获取、性能优化、安全管理等方面的问题。希望本教程能帮助你成功部署和使用 DeepSeek 模型。 以上代码和步骤仅为示例,实际部署过程中可能需要根据具体情况进行调整。同时,确保你遵守相关的法律法规和模型的使用条款。 |

您可能感兴趣的文章 :

-

在本地快速部署deepseek的操作指南(3分钟极速部署

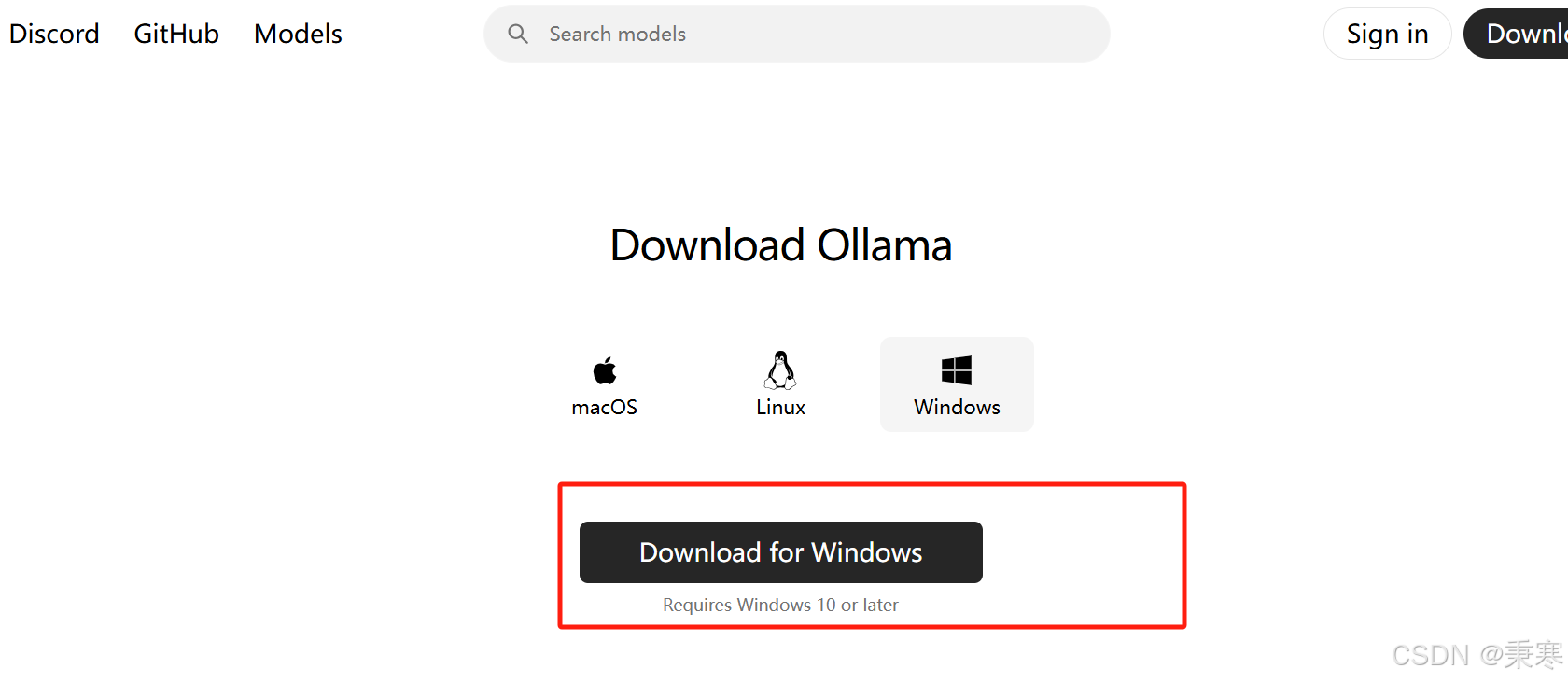

第一步,找到网站,下载: 首先找到Ollama, 根据自己的电脑下载对应的版本 。 我个人用的是Windows 我就先尝试用Windows版本了 ,文件不是很 -

本地私有化部署DeepSeek模型的教程

DeepSeek 模型是一种强大的语言模型,本地私有化部署可以让用户在自己的环境中安全、高效地使用该模型,避免数据传输到外部带来的安全 -

如何本地部署DeepSeek?本地部署DeepSeek的教程

第一步:安装ollama https://ollama.com/download 打开官网,选择对应版本 第二步:选择合适的模型 https://ollama.com/ 模型名称中的1.5B、7B、8B等数字代 -

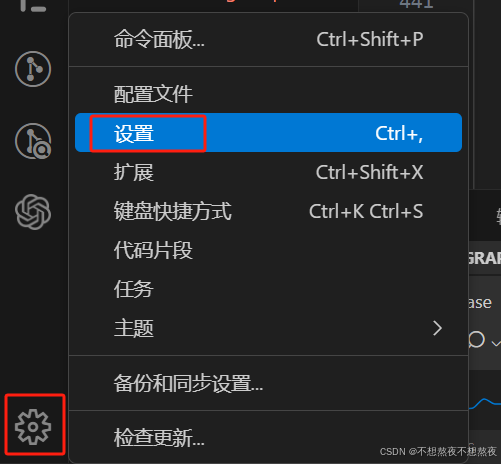

vscode保存代码时自动eslint格式化图文教程

1、点击设置 2、选择远程---点击右上角打开设置 3、会弹出settings.json文件,将以下内容复制进去即可 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 -

5分钟获取deepseek api并搭建简易问答应用介绍

eepseek-v3是截止博文撰写之日,无论是国内还是国际上发布的大模型中表现十分亮眼的模型,这里以deepseek为例,讲解如何获取api_key、base_u -

Git中恢复已删除分支的几种方法

在 Git 中,恢复已删除的分支可以通过几种方法实现,具体取决于你是否已经推送了删除操作以及你是否有本地或远程的引用。以下是几种常 -

vscode任务配置之tasks.json用途介绍

用途说明 在VS Code中配置任务主要涉及到task.json文件的编辑,这个文件允许你定义任务,比如编译、构建、测试、运行相关脚本等。 用途1: -

鸿蒙开发搭建flutter适配的开发环境

环境搭建 1.安装 DevEco Studio NEXT IDE 注意版本应该是 Next,当前最新的是 Beta3 .下载之前需要先登录,后面的模拟器创建还要开发者验证、审核 -

鸿蒙UI开发之滚动组件overscroll-decor安装和使用介

鸿蒙UI开发之滚动组件overscroll-decor是一个开源库,旨在为开发者提供一种简单、灵活的方式来实现各种过度滚动(overscroll)动画效果,提升

-

解决Git Bash中文乱码的问题

2022-04-23

-

webp格式图片显示异常分析及解决方案

2023-04-23

-

typescript 实现RabbitMQ死信队列和延迟队

2024-04-08

-

git clone如何解决Permission Denied(publick

2024-11-15

-

Win10环境下编译和运行 x264的详细过程

2022-10-16