deepseek本地部署流程(解决服务器繁忙以及隐私等问题)

由于官网deepseek老是出问题 所以我决定本地部署deepseek 很简单,不需要有什么特殊技能 正文开始 Ollama 首先到这个ollama的官网 goto-Ollama 然后点击中间这个大大的Download 然后再次点击中间这个大

|

由于官网deepseek老是出问题

所以我决定本地部署deepseek 很简单,不需要有什么特殊技能

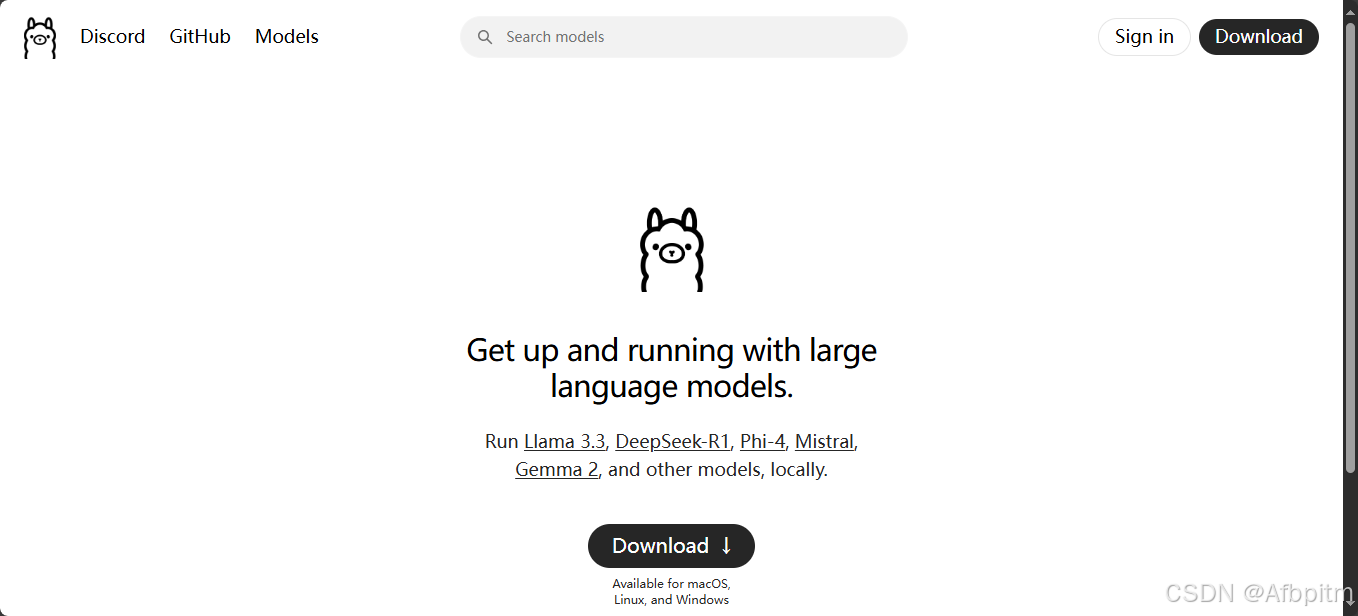

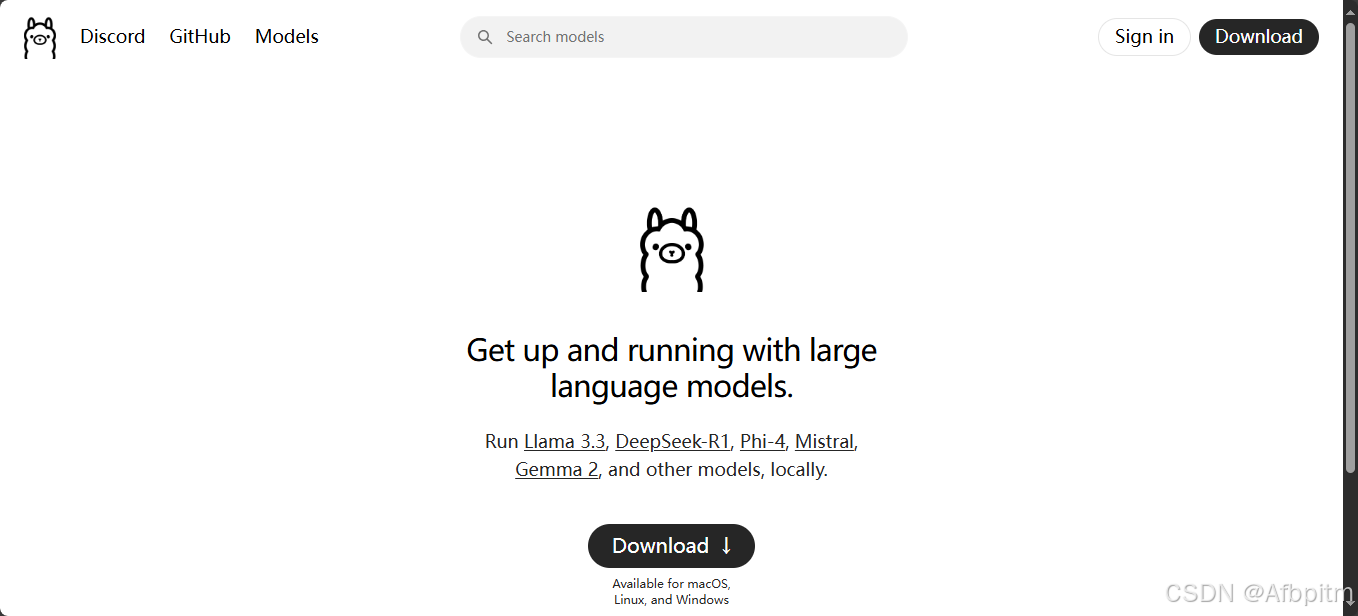

正文开始 Ollama首先到这个ollama的官网 goto-Ollama

然后点击中间这个大大的Download

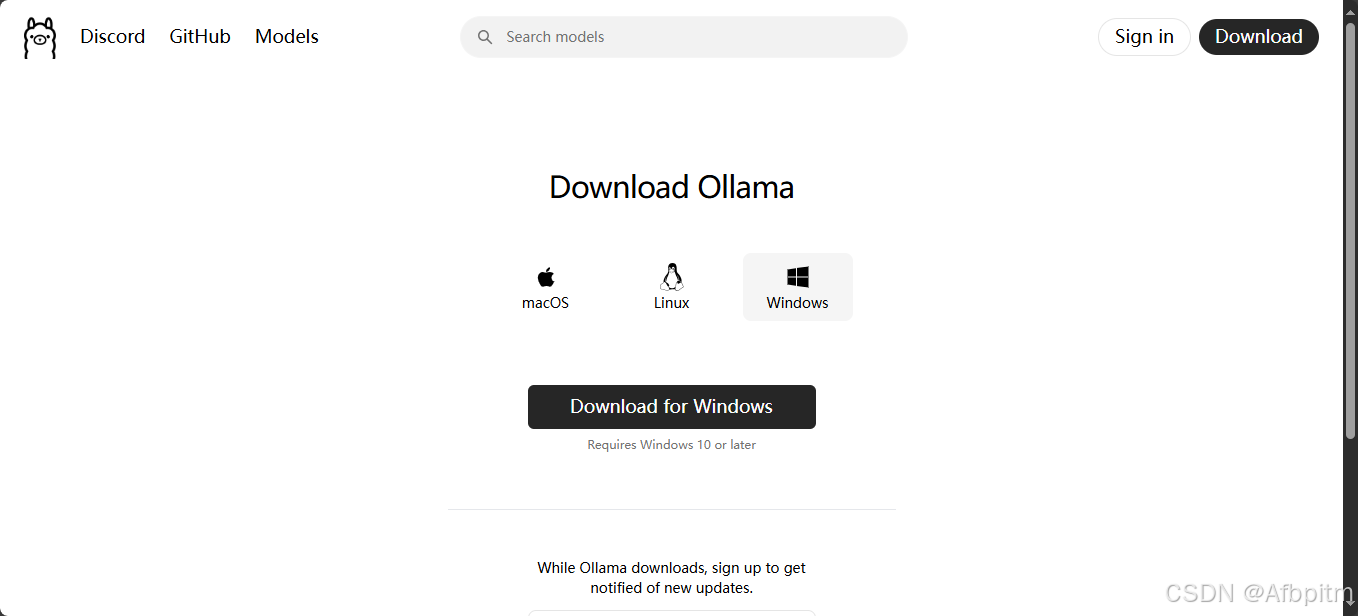

然后再次点击中间这个大大的Download for Windows

等待下载完成

下载完成

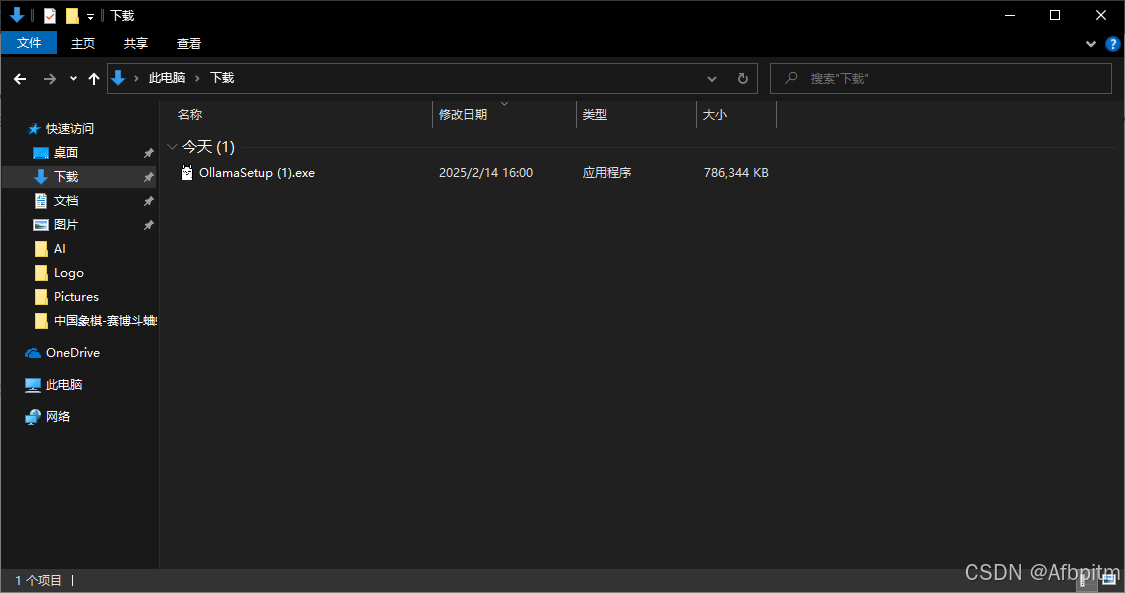

完成后去自己的下载目录文件夹里找下载好的文件,双击打开

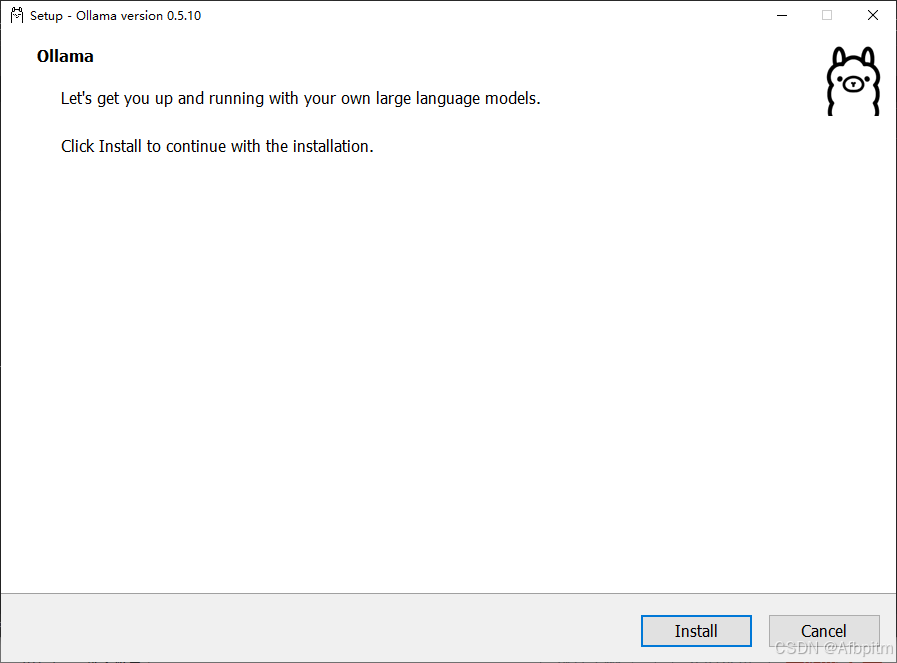

点击Install

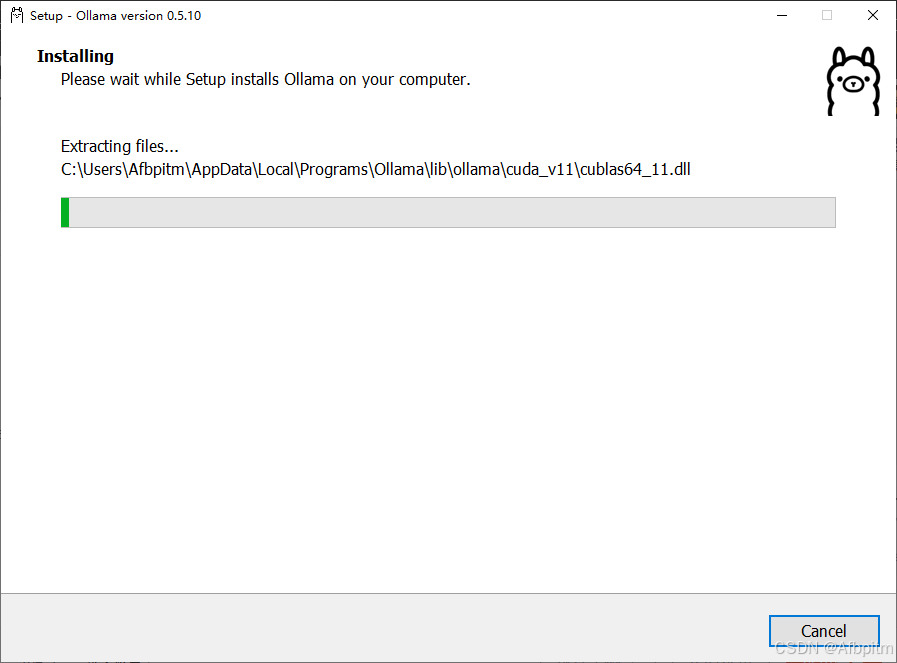

等待安装完成

安装完成

安装完成后查看任务栏向上小箭头 羊驼图标就是ollama的进程 然后进行下一步(不要关ollama进程) ChatBoxAI打开它的官网 goto-ChatBoxAI

然后点击这个免费下载 (for Windows)

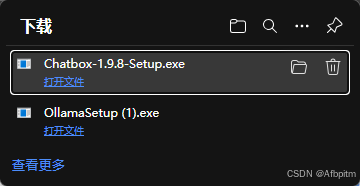

下载开始,等待下载完成

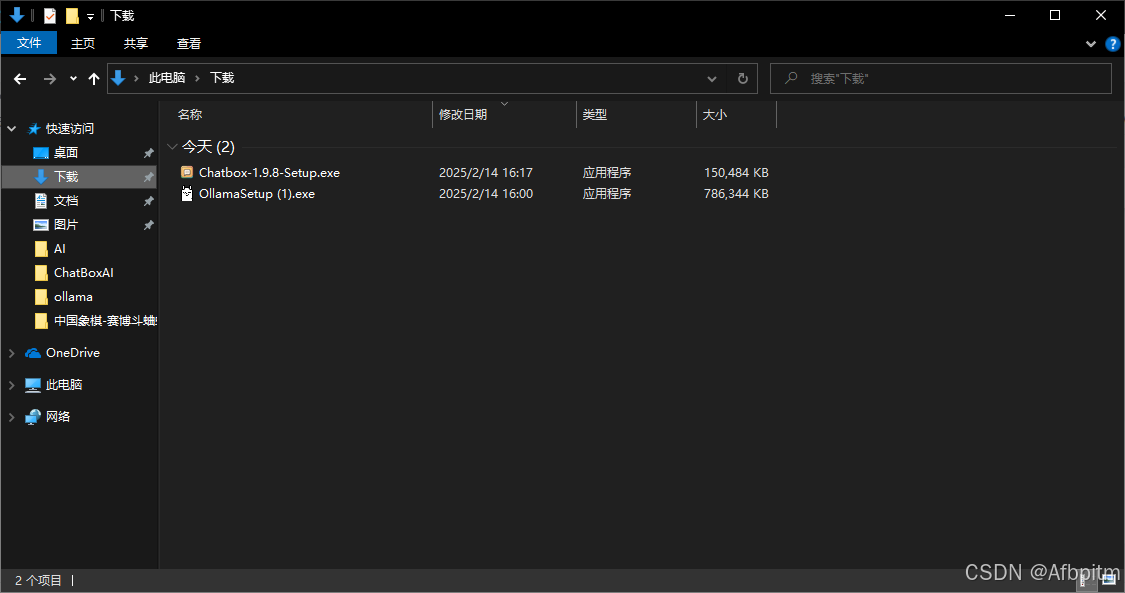

下载完成 打开自己下载文件夹

双击打开下载好的文件

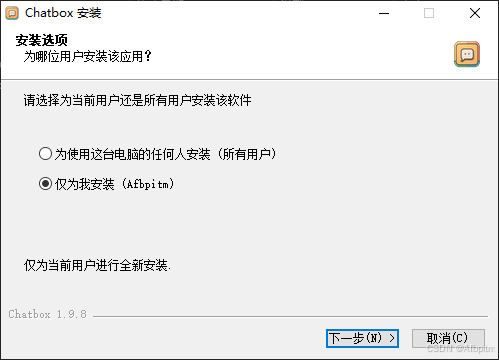

下一步

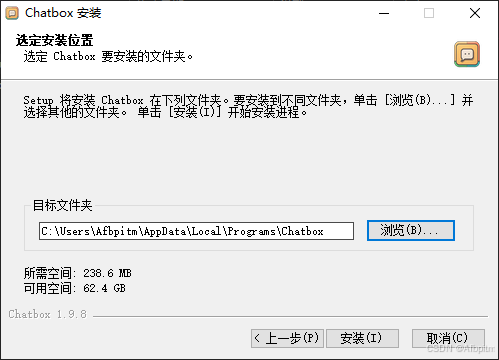

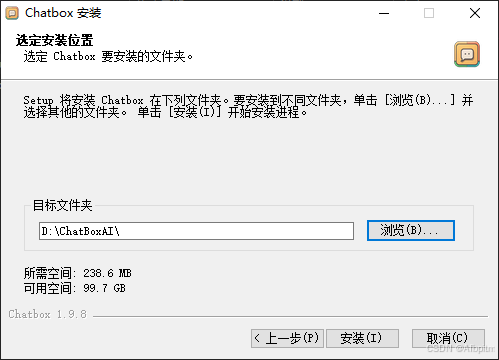

选个安装位置,点浏览

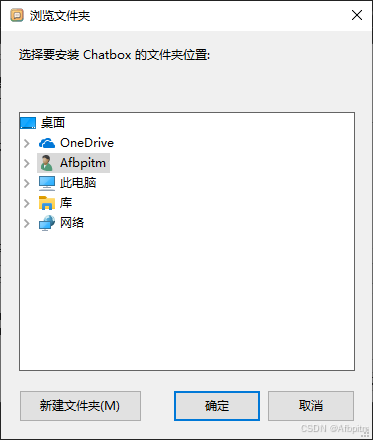

然后就会打开这个

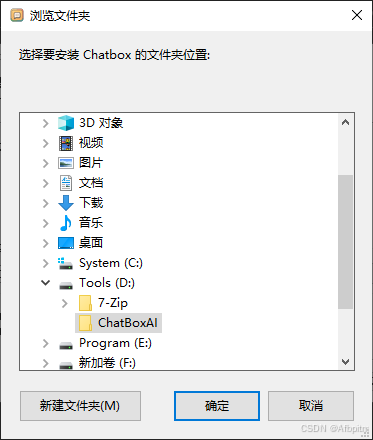

在里面找好自己的目录,点确定

就会跳回这个界面,点安装

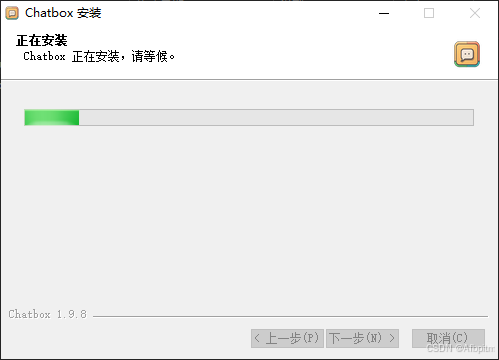

等待安装完成

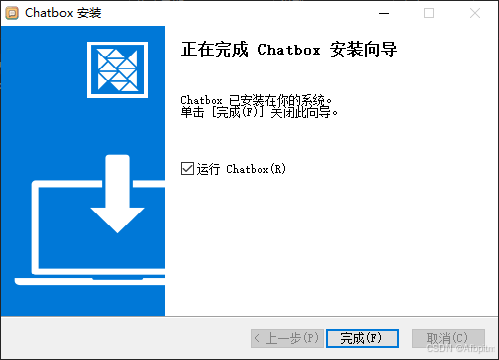

安装完成后,点完成,稍等一会

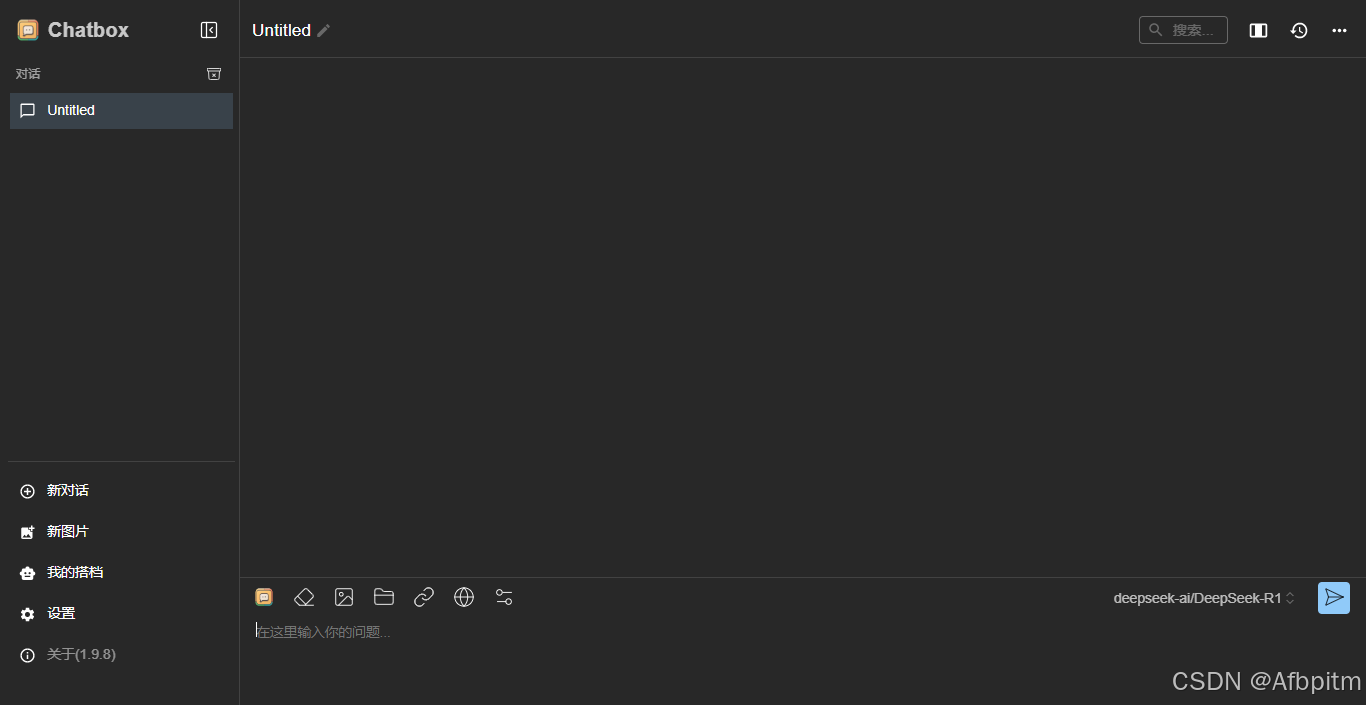

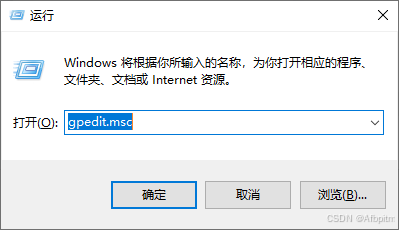

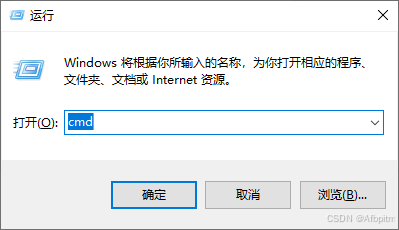

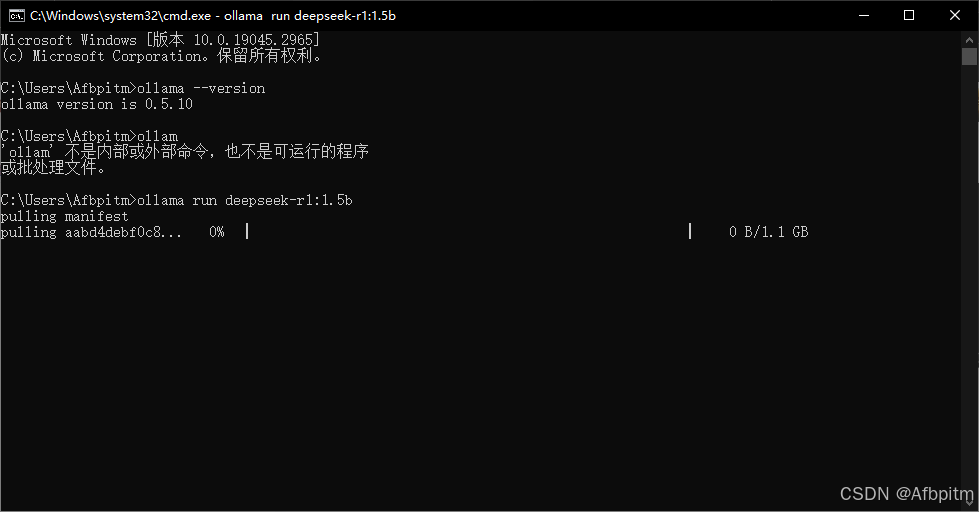

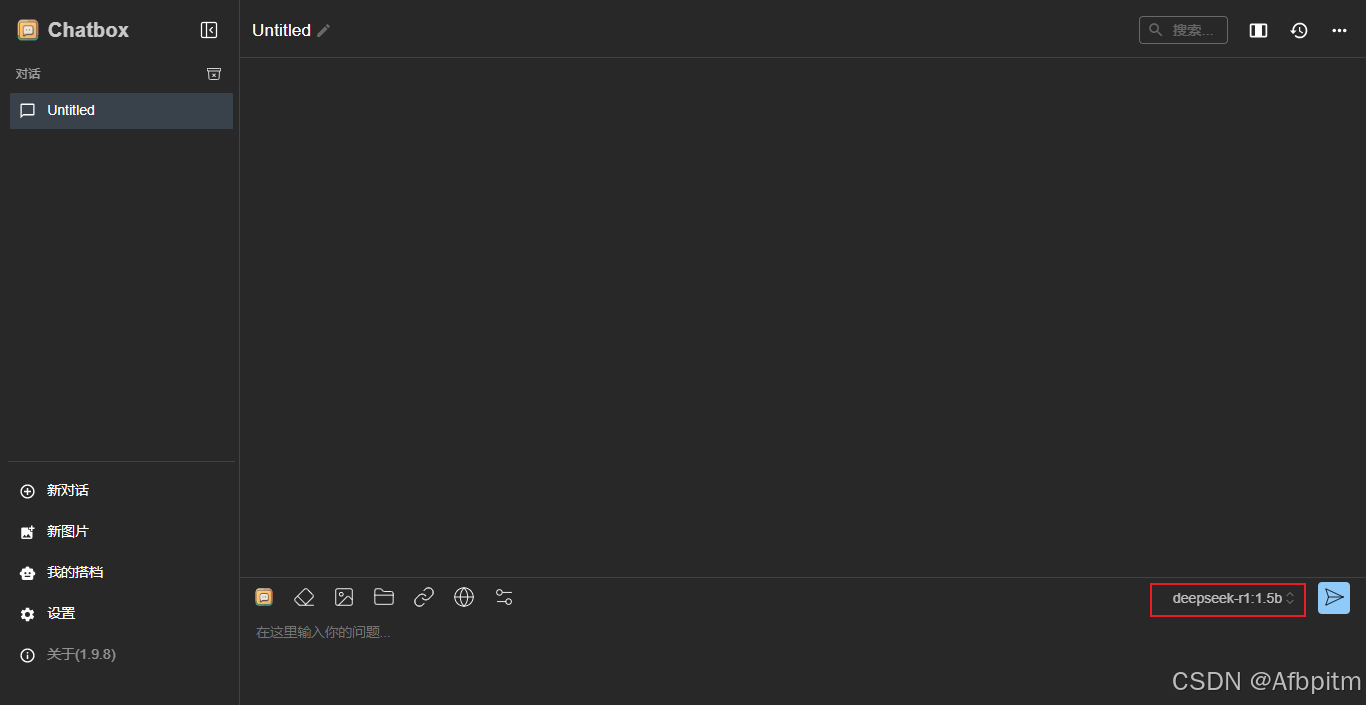

就会出现这个界面(这就是以后跟deepseek对话的地方),关了它进行下一步骤 DeepSeek-R1拉取模型需要在命令行里操作 同时按下Win+R启动运行命令窗口

输入cmd

回车

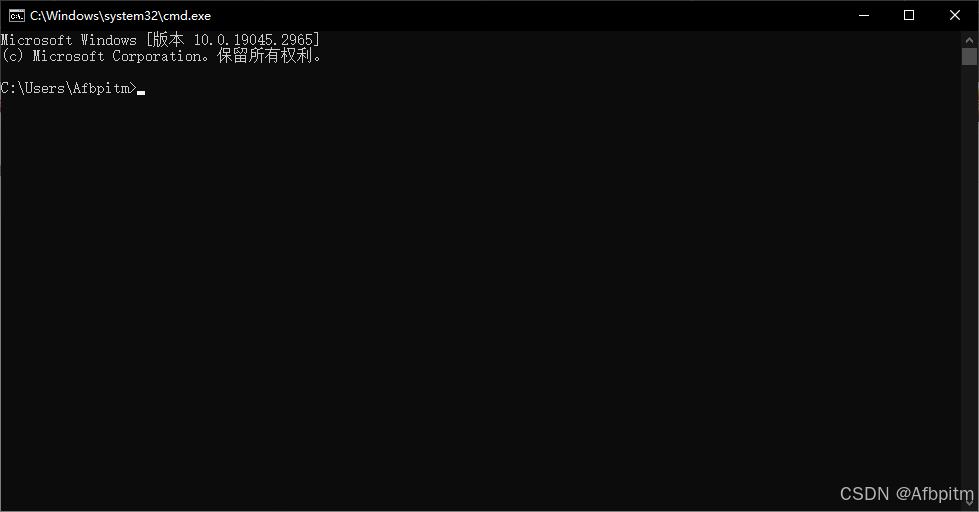

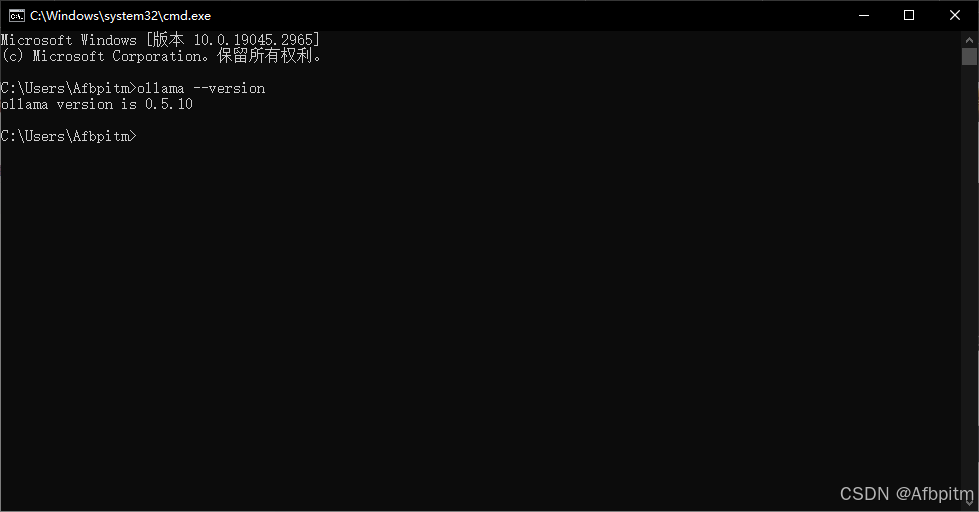

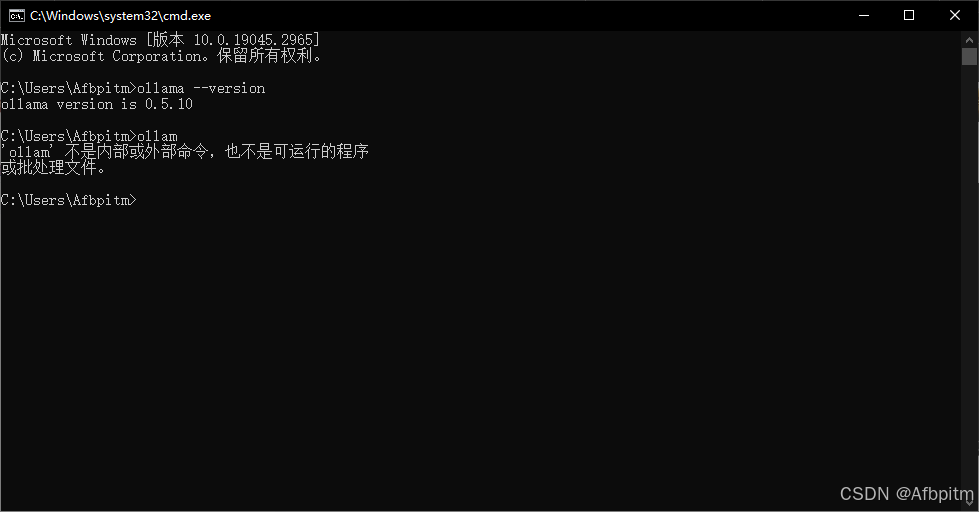

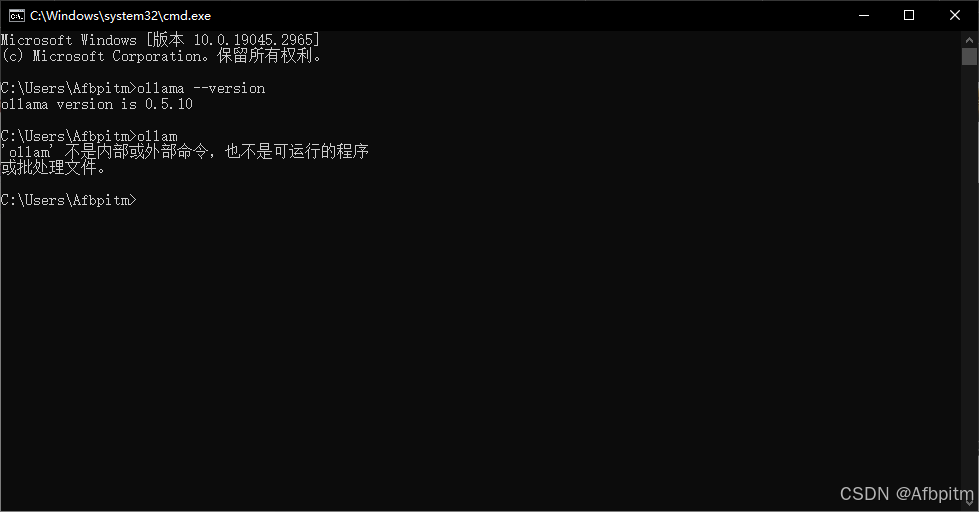

出现这个(命令提示符)窗口,然后输入以下命令

然后就会出现如上提示

如果是这样的,那就说明你没输对命令,如果反复检查是输对了,那你只能回到Ollama章节把那一章的内容重来一遍了 goto-Ollama 然后再次回到Ollama的官网(不要关闭命令提示符)

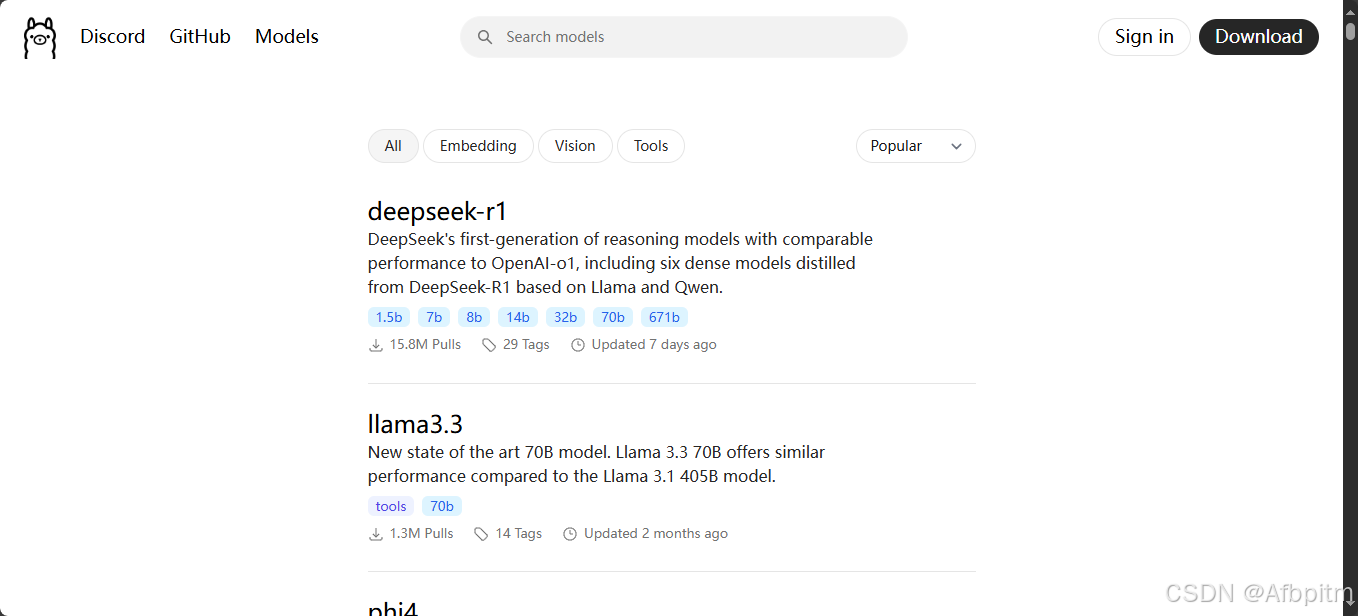

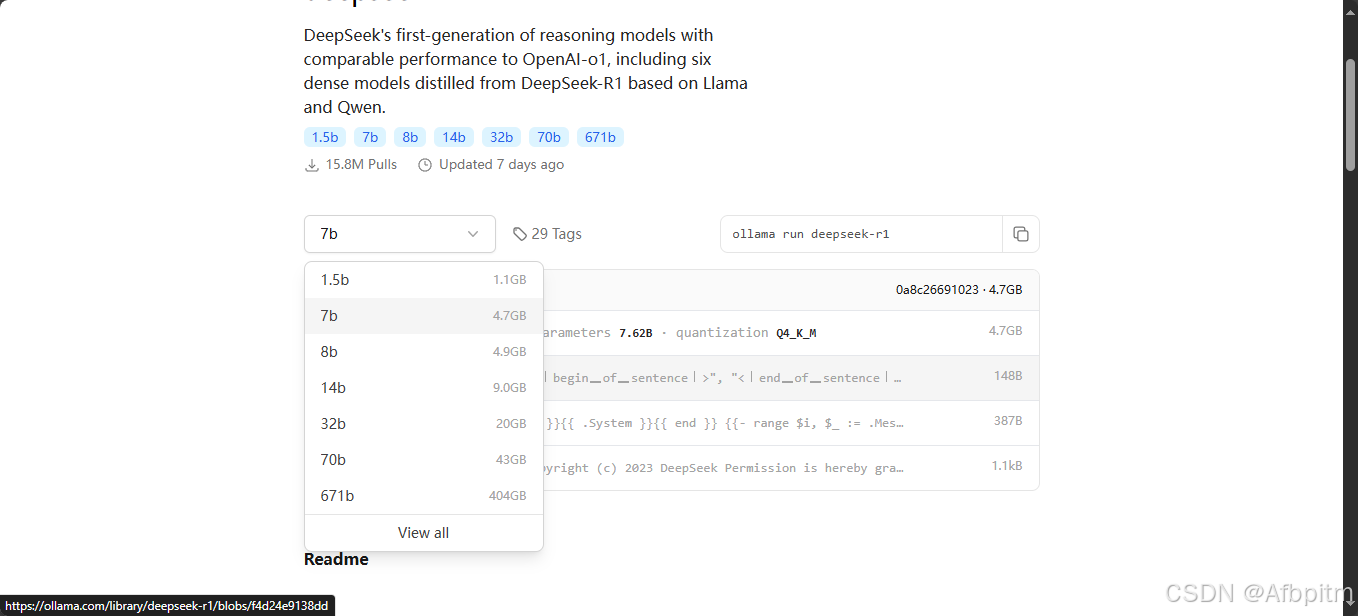

点击Models(左上角)

然后自己选自己的AI,一般就是第一个显示的那个AI-deepseek-r1 点击deepseek-r1

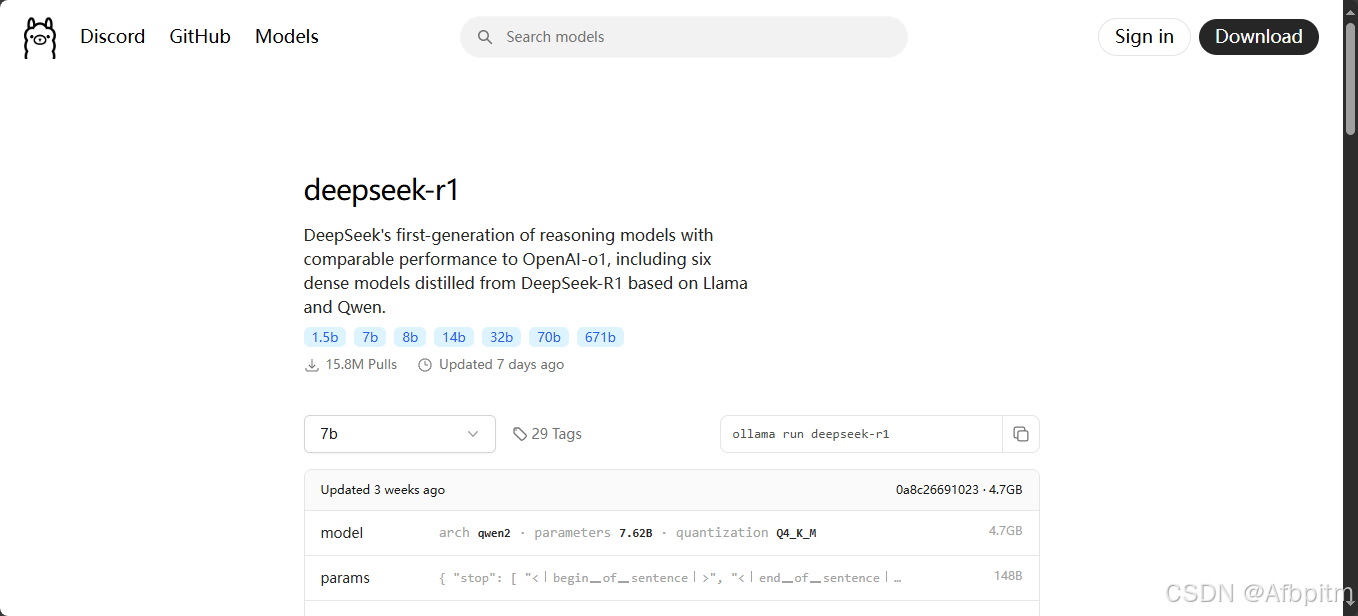

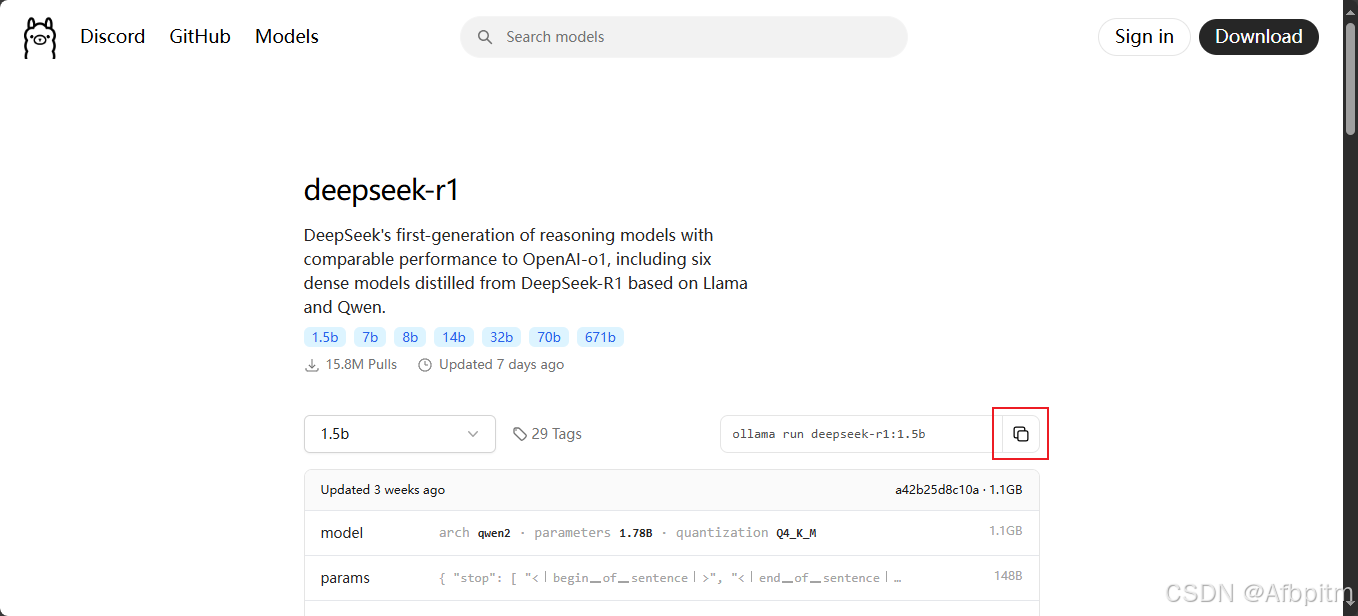

点击下拉框选择适合自己的蒸馏版

选择哪个呢,在Decide章节,自行阅读后选择

选好之后点击上图红框中的copy按钮

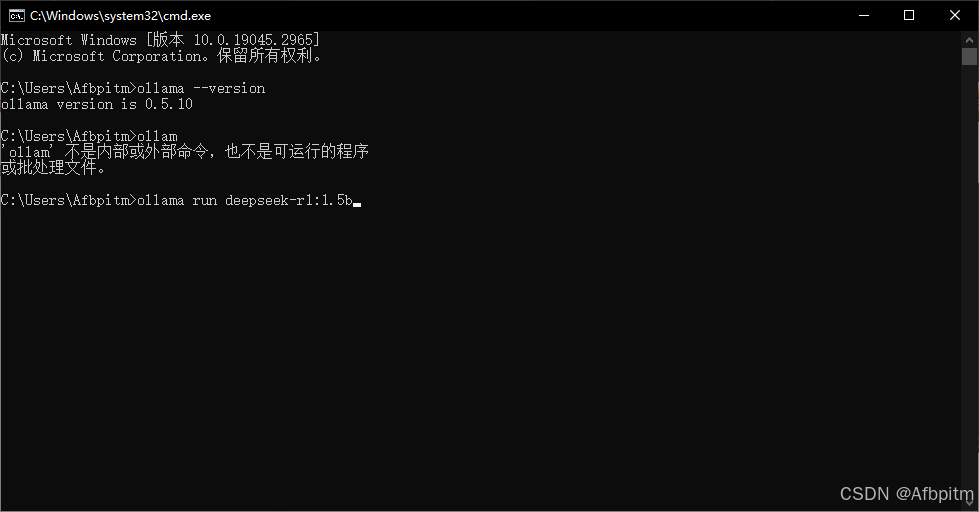

回到命令提示符中,点击右键复制内容

好了之后回车

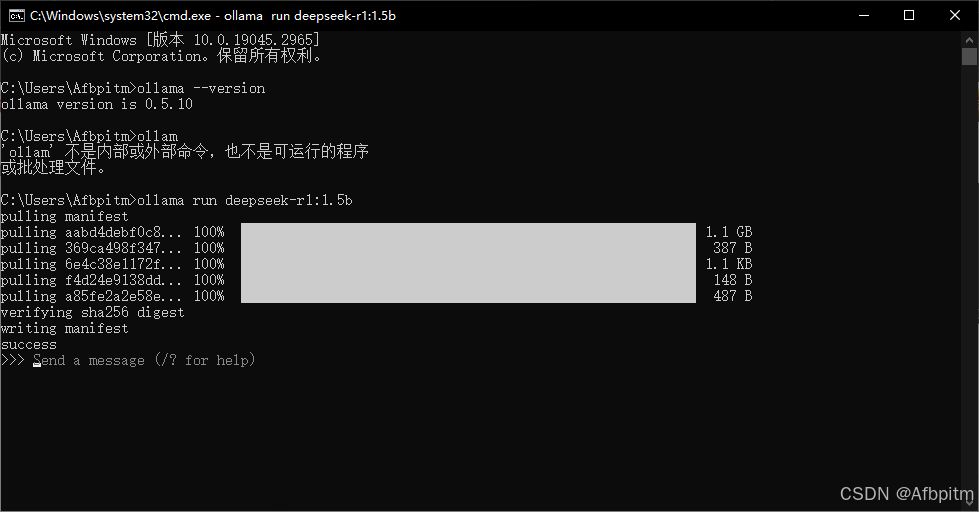

等待拉取模型

模型拉取成功(这里的success表示成功) 然后在命令行里会出现Send a message字样,然后不用管它了 下一步 组装

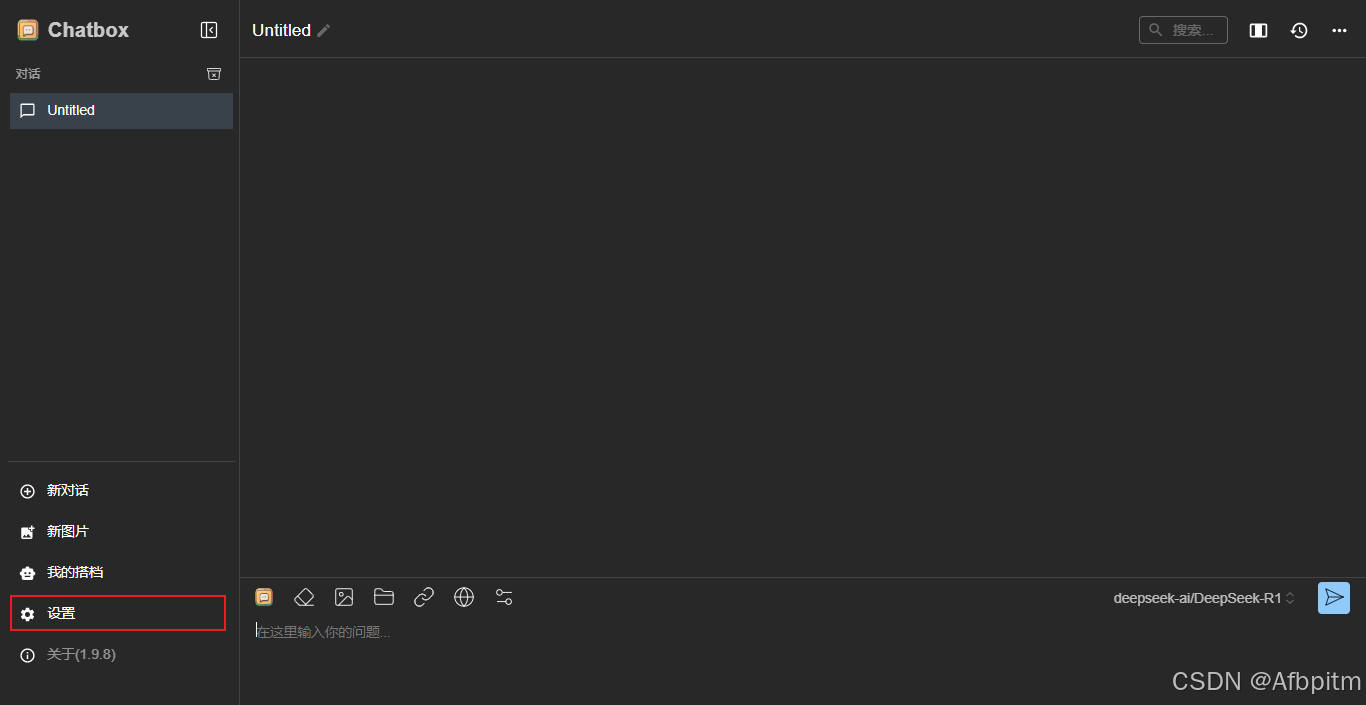

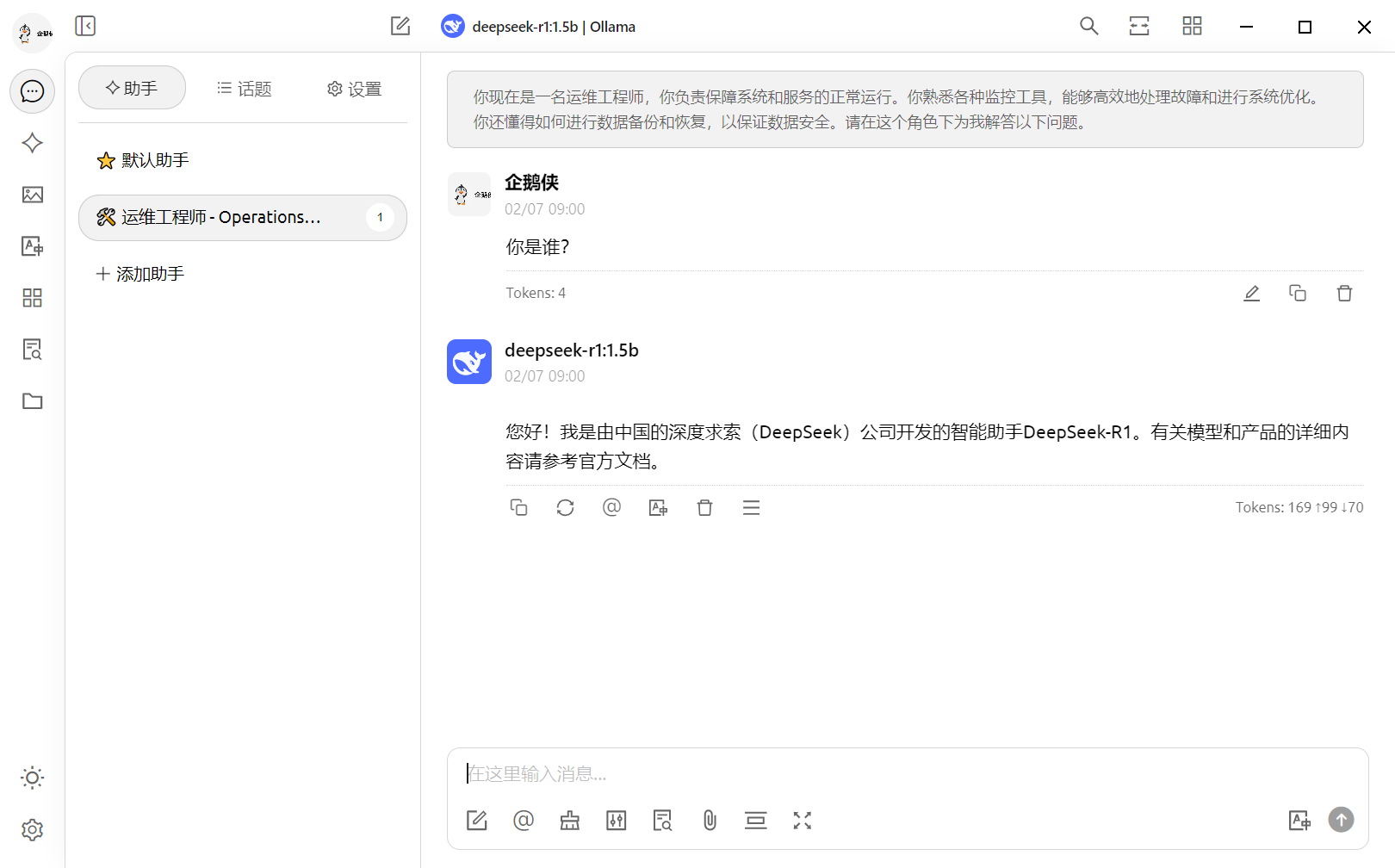

打开桌面上的ChatBoxAI

点击设置

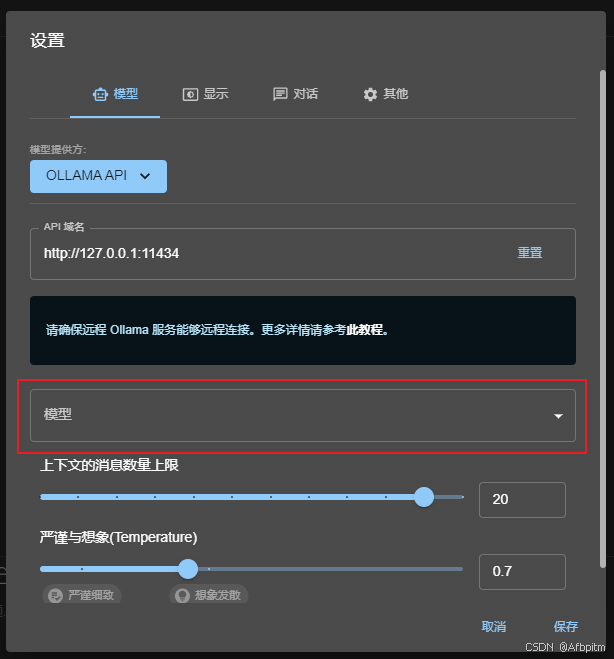

打开模型提供方下拉框

选择上图红框中这个Ollama API

打开模型下拉框

可以看到这里有我们刚刚拉取的deepseek,选择它

保存

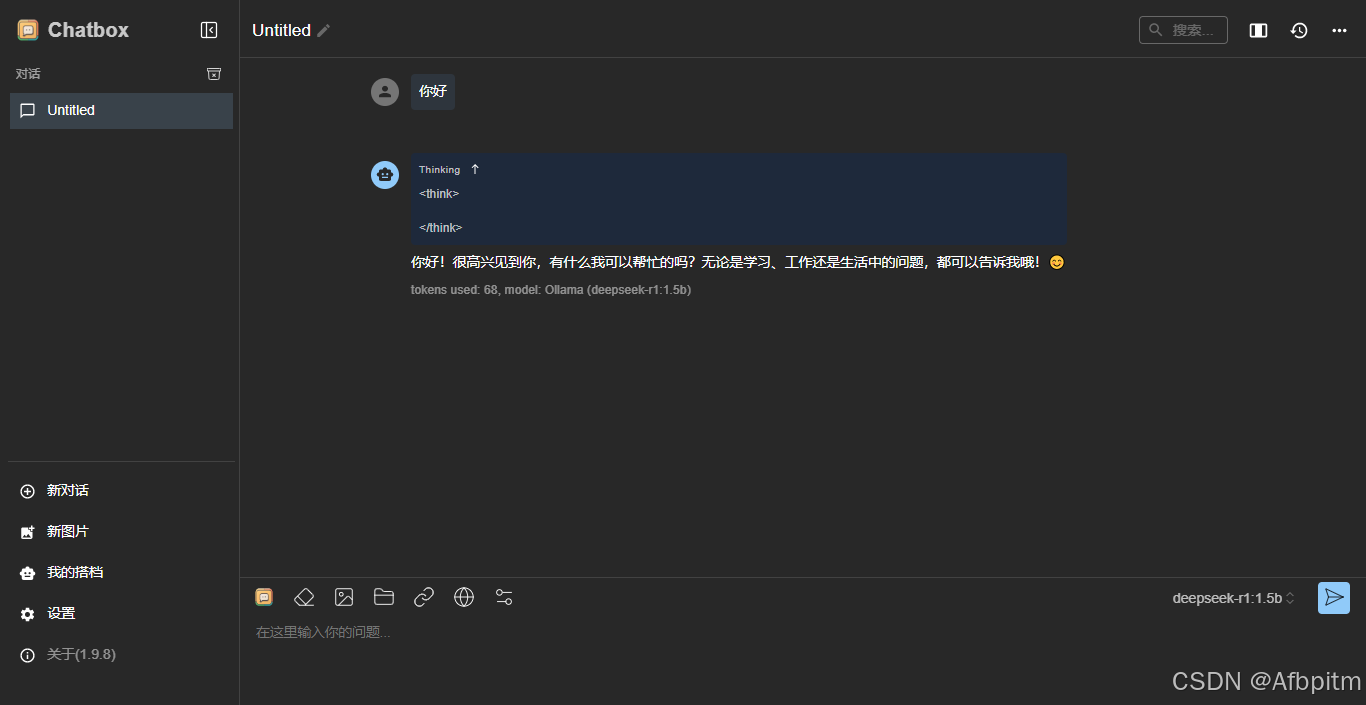

这里也变成自己刚刚拉取的AI了 然后输入一个试试

以后自己打开ChatBoxAI就可以开始对话了 关闭会自己杀死AI进程 Decide

|

您可能感兴趣的文章 :

-

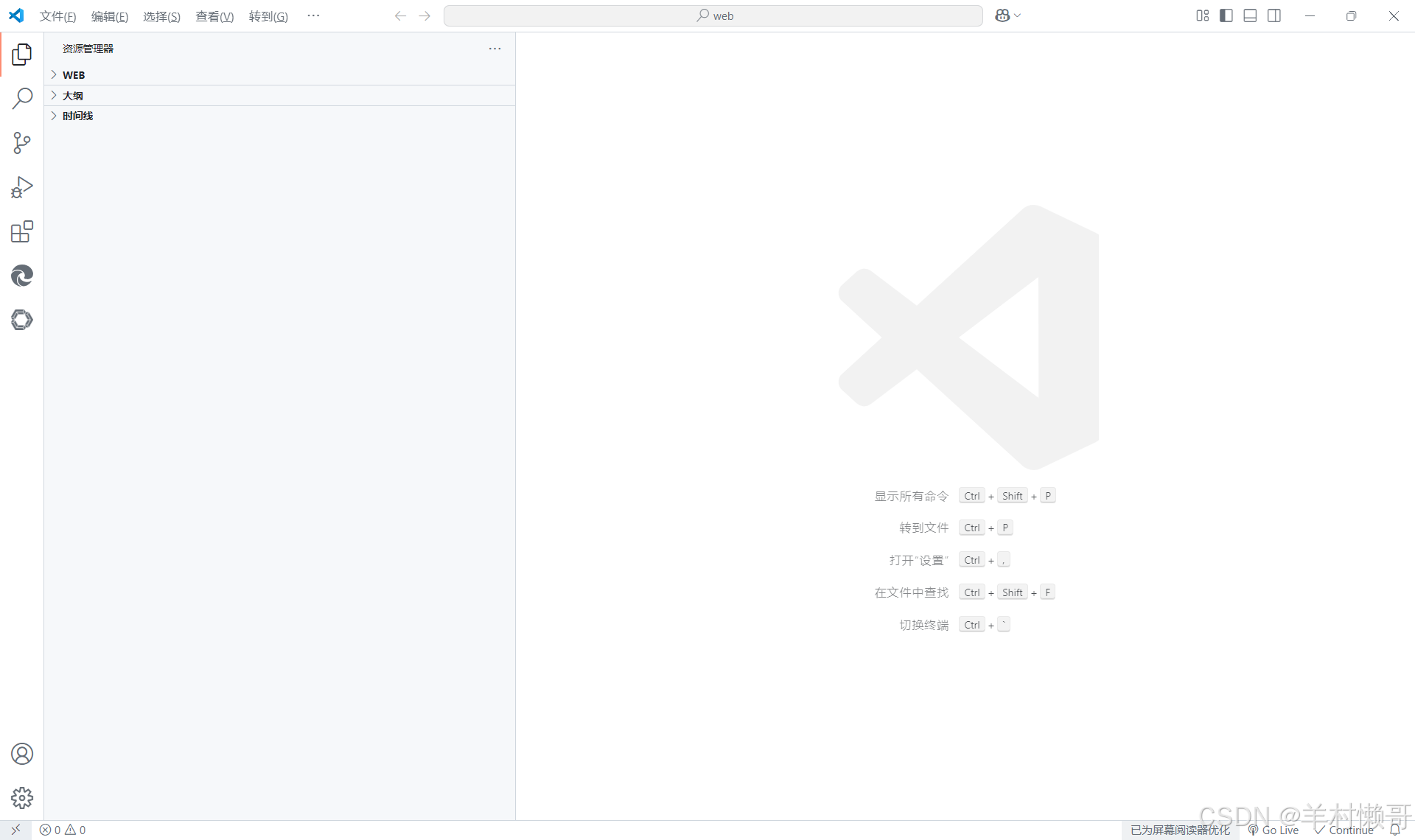

VScode内接入deepseek包过程记录

VScode内接入deepseek包过程 在 VSCode 中集成本地部署的 DeepSeek-R1 模型可以显著提升开发效率,尤其是在需要实时访问 AI 模型进行推理任务时 -

deepseek本地部署流程(解决服务器繁忙以及隐私等

由于官网deepseek老是出问题 所以我决定本地部署deepseek 很简单,不需要有什么特殊技能 正文开始 Ollama 首先到这个ollama的官网 goto-Ollama 然后 -

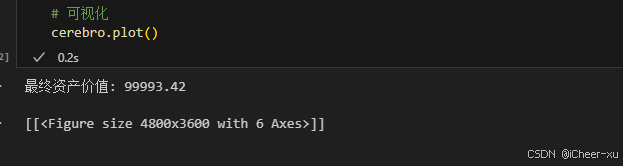

VSCODE内使用Jupyter模式运行backtrader不展示图片、图

一、VSCODE无法展示图片 在Vscode里用jupyter,运行backtrader,使用plot后,图片不展示。 运行代码 # 可视化cerebro.plot() 结果并没有弹出图片,而是 -

完美解决DeepSeek服务器繁忙问题

解决DeepSeek服务器繁忙问题 三:最为推荐 一、用户端即时优化方案 网络加速工具 推荐使用迅游加速器或海豚加速器优化网络路径,缓解因 -

Deepseek R1模型本地化部署+API接口调用详细教程(释

随着最近人工智能 DeepSeek 的爆火,越来越多的技术大佬们开始关注如何在本地部署 DeepSeek,利用其强大的功能,甚至在没有互联网连接的情 -

DeepSeek部署之GPU监控指标接入Prometheus的过程

一、背景 上一篇文章介绍了在GPU主机部署DeepSeek大模型。并且DeepSeek使用到了GPU资源来进行推理和计算的过程,加速我们模型的回答速度。 -

Deepseek使用指南与提问优化策略方式

随着人工智能技术的迅猛发展,语义搜索已成为提升信息检索效率和用户体验的核心工具。DeepSeek 作为一款先进的语义搜索引擎,通过自然 -

DeepSeek Window本地私有化部署教程介绍

最近大火的国产AI大模型Deepseek大家应该都不陌生。除了在手机上安装APP或通过官网在线体验,其实我们完全可以在Windows电脑上进行本地部署 -

DeepSeek本地部署流程介绍

随着人工智能技术的飞速发展,本地部署大模型的需求也日益增加。DeepSeek作为一款开源且性能强大的大语言模型,提供了灵活的本地部署方 -

DeepSeek服务器繁忙问题的原因分析与解决方案(最

随着人工智能技术的飞速发展,DeepSeek 等语言模型在众多领域得到了广泛应用。然而,在春节这段时间的使用过程中,用户常常遭遇服务器

-

解决Git Bash中文乱码的问题

2022-04-23

-

webp格式图片显示异常分析及解决方案

2023-04-23

-

typescript 实现RabbitMQ死信队列和延迟队

2024-04-08

-

git clone如何解决Permission Denied(publick

2024-11-15

-

Win10环境下编译和运行 x264的详细过程

2022-10-16